Read next

Themenspektrum der Ausstellungen auf der China International Fair for the Elderly (CISSE) 2026

Die mit Spannung erwartete China International Senior Care Expo (CISSE) 2026 findet vom 1. Mai bis 1. Januar 2026 im Chi...

Articles

2026-03-30

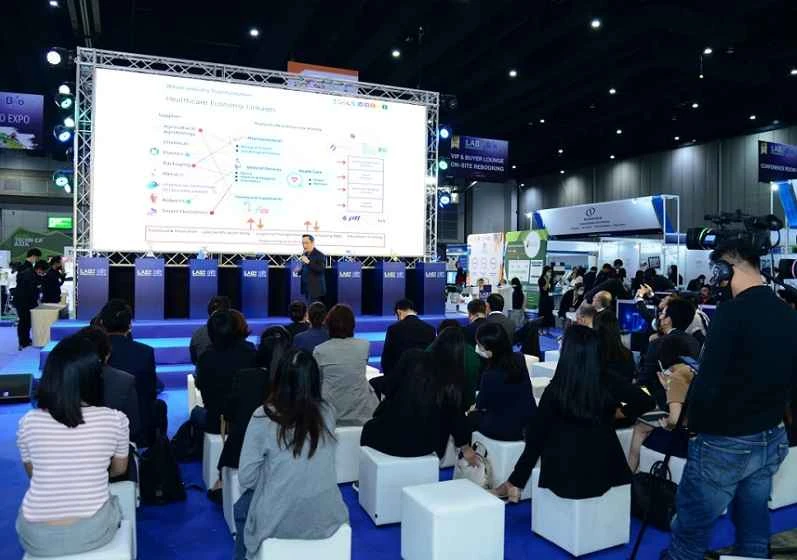

Thailand Lab 2026 Ausstellerleitfaden (Zeit, Ort/Besucherreservierung)

Articles

2026-03-30

Wo kann man Tickets für die Guangzhou Outdoor Show (COSP) 2026 kaufen?

Articles

2026-03-30